Cuando hablamos de Inteligencia Artificial (IA) muchos recuerdan la serie Years and Years o Black Mirror, donde un sistema informático es creado para imitar la inteligencia humana. En la actualidad podemos ver cómo este tipo de tecnología pasó de la ciencia ficción a la vida real a una velocidad que deja poco espacio para el análisis. ¿Hacia a dónde nos lleva la IA?

Ariandna Valbuena Badell

Hace poco más de un año, se supo del sistema de chat basado en el modelo de lenguaje por Inteligencia Artificial, mejor conocido como ChatGPT, entre muchas más que pueden crear textos, imágenes y audios que parecen totalmente reales, pero no son más que una realidad virtual creada desde la Inteligencia Artificial y llevada a la vida cotidiana fuera de lo digital.

Tomemos como ejemplo la serie Black Mirror y el capítulo donde aparece la artista Miley Cyrus, interpretando a una cantante llamada Ashley Too. Una adolescente solitaria se obsesiona con una muñeca robótica creada a partir de la figura de su ídola pop, Ashley O. Al mismo tiempo, la verdadera vida del personaje interpretado por Cyrus comienza a desmoronarse y es reemplazada por su copia virtual. Sea como sea, con un sólo capítulo, los productores de la serie -a propósito o no- instalaron en spotify una “ciberartista” con cientos de miles de seguidores, que acumula millones de reproducciones y un éxito comercial que ya lo quisiera una persona de carne y hueso.

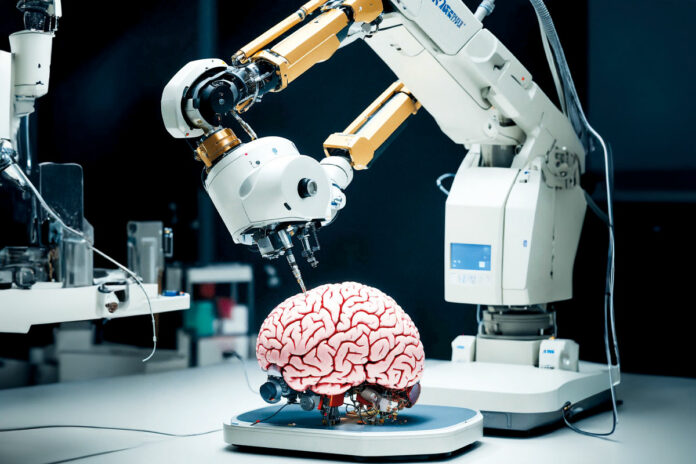

IA y el futuro de la Medicina

La IA ha emergido como una poderosa herramienta en el campo de la medicina, que está siendo utilizada por los médicos para la elaboración de trabajos administrativos, recetas médicas, tratamientos, investigación de distintas enfermedades y también en diagnósticos. Aunque el avance pueda ser significativo y de gran ayuda para la salud, estos sistemas que trabajan a través de algoritmos y patrones para realizar tareas de manera autónoma, no cuentan con una de las capacidades más importantes de un médico: los límites éticos y la habilidad humana.

Si bien podemos ver como la IA estaría aportando a la medicina, también plantea desafíos éticos y regulaciones importantes. Entre los puntos a destacar serían la privacidad, responsabilidad y la protección de datos, esto por mencionar algunos. “Esta es una herramienta que se usa en la medicina y en la educación de muchos campos. Desde el punto de vista ético general las herramientas de IA lo primero que tienen que asegurarnos es el acceso. ¿Por qué?, porque si queremos mejorar la salud, el conocimiento, la educación, entre muchas aristas más, tenemos que hacer que llegue a todas las personas. Además, de implementar una regulación que debería ser transversal en la protección de la información y la confidencialidad”, agregó la Dra. Gladys Bórquez, presidenta del Departamento de ética del COLMED.

Dentro de los avances de la IA en la medicina, destaca la elaboración de diagnósticos, esto podría generar varias interrogantes. ¿Es necesario que un médico valide estos diagnósticos? ¿Este sistema evalúa las necesidades individuales del paciente o sólo se basa en un diagnóstico generalizado?

“Hay varios campos de acción importante para obtener un buen diagnóstico, entre esos los que son por imágenes, tanto radiológicas, como también, los avances tecnológicos que permiten calcular la edad ósea de un niño, que anteriormente lo calculaba un médico que miraba un atlas y lo comparaba con las radiografías del niño. Hoy, se puede hacer con ayuda de la Inteligencia Artificial. Cuando se da un diagnóstico creado por la IA, lo más importante es comparar si estos resultados son seguros en relación a lo que nosotros, médicos y médicas, decimos el estándar o la prueba de oro. Por lo tanto, es primordial proteger ante todo la seguridad del paciente y también la calidad de lo que estamos haciendo”, agregó la Dra. Anamaría Arriagada, presidenta del Colegio Médico Nacional y Magíster en Bioética.

En contexto de la implementación de la IA en el trabajo médico y los desafíos que podrían enfrentar; y el avance continuo que tienen estos sistema de informática, donde fácilmente pueden generar diagnósticos de manera autónoma y evaluar una inmensa base de datos sin necesidad de un médico. Por eso, la autonomía de esta tecnología es una de las primeras alertas debe levantarse de acuerdo al Dr. Paulo Gnecco, presidente del Departamento de Formación y Acreditación. A su juicio es importante que los profesionales de la salud aprendan cómo y cuándo implementar estas herramientas. “En términos prácticos es relevante la inclusión de herramientas sustentadas. Su uso bien aplicado puede ahorrar tiempo simplificando procesos, permitiendo a médicos centrarse en los aspectos medulares. La justificación de ceñirnos -o no- a las recomendaciones que plantee la IA y la posible pérdida de soberanía respecto a nuestra información personal y el problema de las respuestas estandarizadas a situaciones concretas son algunos de los problemas que la profesión médica podría enfrentar”, agregó el Dr. Gnecco.

Margen de error

Sabemos que como existen los errores humanos, también existen los errores de estos sistemas de informática, donde el margen de error puede ser entre el 1% o 2,5% y dependerá de los algoritmos utilizados. Un estudio realizado por la Universidad de Heidelberg (Alemania) y de la Inception CNN (herramienta de IA desarrollada por Google), donde participaron varios médicos, analizaron distintas imágenes de melanomas, malignas y benignas. Los médicos identificaron un 71,3% de las lesiones malignas, mientras que la IA logró un promedio de 95% como resultado de dichas lesiones. Sin embargo, se pudo observar que la IA calificó muchas lesiones que eran benignas y las clasificó como malignas, lo cual estaría dando un diagnóstico erróneo. Hay que tener en cuenta que existe -y seguirá existiendo- un margen de error inherente en cualquier sistema de inteligencia artificial.

La IA está ganando terreno, también, en el proceso de formación médica, siendo un gran aliado para las y los estudiantes de medicina, ya que les permite realizar prácticas médicas digitales, además, de facilitar la manera en cómo se evalúa el desempeño de los estudiantes. “La IA es una herramienta que se ha incorporado con distintos niveles de intensidad en la formación médica tanto de pregrado como de postgrado. En radiología, métodos de reconocimiento de lesiones endoscópicas in situ; análisis de lesiones cutáneas en lo que podría considerarse como una IA enfocada en los aspectos gestálticos de la medicina. Su incorporación en análisis de interacciones médico-paciente, o bien en uso para resolución de casos clínicos son otros ejemplos de su aplicación en un plano ético y de razonamiento. Probablemente pronto encontraremos incursiones de la Inteligencia Artificial en todas las áreas de la medicina”, expresó el Dr. Paulo Gnecco, presidente del Departamento de Formación y Acreditación.

El desafío ético

Es posible que en el futuro la IA juegue un papel más significativo, abarcando más áreas de la medicina, aun así, es importante asegurar que su uso sea ético, seguro y sea de complemento para la evaluación médica.

“Para nosotros los médicos, la medicina más que ciencia es arte. Tomemos como ejemplo, que nosotros como médicos nos encontramos con un paciente enfermo, no con una enfermedad. Entonces estos sistemas informáticos van a probablemente entregar herramientas en base de la enfermedad y no una evaluación del paciente en cuanto a sus necesidades. Uno como médico debe diferenciar entre el paciente enfermo, como sufre la enfermedad, y de acuerdo a eso sugerir la indicación que mejor parezca. Entonces, imaginemos que esta es una herramienta que no sólo nos ayude a decidir, sino que nos obligue y la pregunta sería: ¿Va a ser obligatorio usarlo sí o no?”, agregó la Dra. Gladys Bórquez, presidenta del Departamento de Ética.